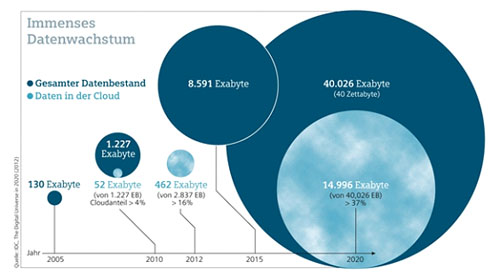

Abbildung 1: Prognose zum Datenwachstum weltweit und Datenanteil in Cloudsystemen [2]

2015 lag der weltweit generierte Datenbestand bei ungefähr 8600 Exabytes (8.6 x 1021). Dieser wird bis 2020 voraussichtlich auf ca. 40 Zettabytes (40 x 1021) anwachsen.[2] Die von Maschinen generierten Daten, also die M2M-Kommunikation, kommen in der Regel zwar in weniger grossen Paketen daher, die Firma Cisco schätzt aber, dass bis 2019 bis zu 10,5 Milliarden Geräte vernetzt sein werden, die ständig kommunizieren und deren Anteil somit ebenfalls bedeutend anwächst.[1]

Vorsprung durch geeignete IT-Lösungen

Die enorme Anzahl Datensätze, die täglich von Millionen von Menschen und Maschinen generiert werden, eröffnen Firmen diverse neue Möglichkeiten, Wettbewerbsvorteile zu erlangen. Viele Firmen verfügen aber nicht über die nötigen Ressourcen und Infrastrukturen, um die Daten in nützlicher Frist selbst auswerten zu können. Sie sind darum auf externe Rechenpower angewiesen. Eine sehr bequeme Lösung stellen dabei Clouds dar. Der wohl bekannteste Anbieter ist Google mit seiner Cloud-Computing-Plattform (cloud.google.com). Einerseits können darauf grosse Datenmengen verarbeitet werden, beispielsweise für Simulationen, andererseits können riesige Datensätze über sogenannte Queries abgefragt und somit sehr schnell ausgewertet werden. Diese aufbereiteten Daten können beispielsweise zu einer Effizienzsteigerung in der Produktion und im Verkauf führen oder zur Schaffung von neuen Geschäftsfeldern genutzt werden. Gleichermassen sind Forschungsinstitute, medizinische Einrichtungen oder staatliche Organisationen an diesen Daten und Auswertungen interessiert, um daraus neue Erkenntnisse zu gewinnen. Abbildung 1 zeigt deutlich, dass die Datenverarbeitung in Clouds anteilsmässig stark ansteigen wird.

Mehr Daten – mehr Ressourcenverbrauch?

Die rasante Entwicklung im Internet bedingt immer mehr Rechenleistung und Speicherkapazität in Rechenzentren, damit die exponentiell steigende Datenflut bewältigt werden kann. Dies hat unweigerlich einen massiv steigenden Energie- und Ressourcenverbrauch zur Folge. Selbst wenn die gewonnenen Erkenntnisse zur immer effizienteren Produktherstellung verwendet werden, führt dies im Endeffekt zu zusätzlichem Energie- und Ressourcenverschleiss, da die Gesamtanzahl Geräte und die weltweite Vernetzung stets zunimmt. Innovative technische Lösungen zur Verbesserung der Energieeffizienz, aber auch zur Steigerung der Ressourcenproduktivität (Herstellung, Recycling) sind zukünftig von entscheidender Bedeutung.

Quellen und weiterführende Informationen: